/ 导读 /

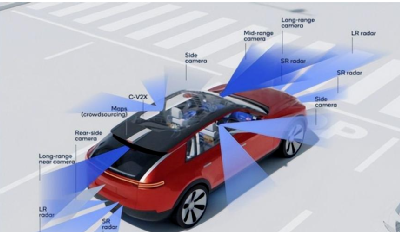

对于目前火热的自动驾驶而言,普通人可能会产生疑问,自动驾驶系统如何感知周围环境并做出相应的合理的决定并执行?其实,自动驾驶技术的主要模块共三大类,即感知、规划和控制。它们之间相互协作,共同为车辆的安全性与舒适性保驾护航。简单来说,感知由环境建模和本地化组成,它们分别依赖于外界和本体的传感器。规划旨在基于感知结果传递的信息来生成最佳轨迹,以便到达给定的目的地。最后,控制模块专用于通过命令车辆的执行器来跟踪生成的轨迹。

在这其中,感知模块作为自动驾驶的“眼睛”,是车辆检测的主要技术,也是自动驾驶自主行驶的基础与前提。

作为软件栈的最上游,感知模块目前是自动驾驶领域最为火热的方向,而只有成熟解决该块难题,自动驾驶才能翻过一座山,继续向下游决策大脑领域发起总攻。本文将带领读者详细了解目前最为关键的感知检测技术。

1

什么是自动驾驶的感知模块?

感知是将各类硬件传感器采集到的数据进行收集、处理,并生成实时的感知结果的过程。感知层的传感器类型一般包括激光雷达、摄像头、毫米波雷达、超声波雷达、速度和加速度传感器等。对于不同的传感器,其优势与特征都是各不相同的,大多数自动驾驶都需要配备多种传感器,才能在复杂的世界中对外界物体进行尽可能完美地感知。

激光雷达(LiDDAR):能释放多束激光,接受物体反射信号,计算目标与自身的距离。激光雷达提供生成环境的3D点云图像提供一系列的(x, y, z)坐标,与已有的高精度地图上的坐标进行对比,就可以很精确地做出车辆定位。激光雷达是自主发射光线并搜集反射信号,因此可以在夜间环境工作。但当天气条件恶劣,如大雪大雾等,会对激光造成影响,使得准确性下降。

毫米波雷达:毫米波雷达发出和接收的是电磁波,与激光雷达相比毫米波雷达会有很多测量短距离的场景,如侧向警示、倒车警示等。全天候工作使其不可或缺,但分辨率低,同样难以成像。相比于激光雷达,毫米波的技术非常成熟,从上世纪90年代开始应用于自适应巡航。毫米波雷达凭借可穿透尘雾、风雪、不受恶劣天气影响、可全天候工作的绝对优势,成为自动驾驶不可或缺的主力传感器。

摄像头:自动驾驶的“眼睛”,识别标识、物体,但无法点阵建模、远距测距。摄像头的技术最为成熟,车载应用起步最早,在ADAS阶段作为绝对主流的视觉传感器。进入自动驾驶时代,由于摄像头独有的视觉影像识别功能,是名副其实的自动驾驶的眼睛。根据多传感器系统的融合,摄像头需要至少6个以上。目前产业内的龙头由于成本、技术和客户等优势,新进入者不容易获得竞争优势。

在拥有了每种传感器所感知到的物体之后,接下来便是将其融合。

2

感知融合技术

进行自动分析和综合,以完成所需的决策和估计而进行的信息处理过程。和人的感知相似,不同的传感器拥有其他传感器不可替代的作用,当各种传感器进行多层次,多空间的信息互补和优化组合处理,最终产生对观测环境的一致性解释。

多传感器融合的技术以及工程化落地难度无疑是复杂的,那么为何众多自动驾驶公司依然趋之若鹜,想要攻克工程落地中的一个个难题?这是因为多传感器融合可以很好地应用上每个传感器自身的优势,统一之后为下游输出一个更加稳定、全面的感知信息,让下游规控模块能够根据这些精确稳定的结果实现车辆最终的安全驾驶。可以说一个好的感知融合模块,将极大提升决策的精准性与安全性,也将直接代表了自动驾驶最终的智能表现水平。

3

感知模块的技术分类

其中无人驾驶的视觉感知系统都基于神经网络的深度学习视觉技术,应用于无人驾驶领域,主要分为四个模块:动态物体检测(DOD:Dynamic Object Detection)、通行空间(FS:Free Space)、车道线检测(LD:Lane Detection)、静态物体检测(SOD:Static Object Detection)。

1. 动态物体检测(DOD: Dynamic Object Detection)

动态物体检测的目的是对车辆(轿车、卡车、电动车、自行车)、行人等动态物体的识别。检测的难点包括 检测类别多、多目标追踪、测距精度;外界环境因素复杂,遮挡情况多,朝向不一;行人、车辆类型种类众多,难以覆盖,容易误检;加入追踪、行人身份切换等众多挑战。

2. 通行空间(FS: Free Space)

空间检测是对车辆行驶的安全边界(可行驶区域)进行划分,主要针对车辆、普通路边沿、侧石边沿、没有障碍物可见的边界、未知边界等进行划分。检测的难点包括 复杂环境场景时,边界形状复杂多样,导致泛化难度较大。

不同于其它有明确的单一的检测类型的检测(如车辆、行人、交通灯),通行空间需要准确划分行驶安全区域,以及对影响车辆前行的障碍物边界。但是在车辆加减速、路面颠簸、上下坡道时,会导致相机俯仰角发生变化,原有的相机标定参数不再准确,投影到世界坐标系后会出现较大的测距误差,通行空间边界会出现收缩或开放等问题。

3. 车道线检测(LD: Lane Detection)

车道检测的目的是对各类车道线(单侧/双侧车道线、实线、虚线、双线)进行检测,还包括线型的颜色(白色/黄色/蓝色)以及特殊的车道线(汇流线、减速线等)等进行检测。目前是能在辅助驾驶领域有着较为成熟的应用。

与此同时,车道检测的难点也很多,包括线型种类多,不规则路面检测难度大。如遇地面积水、无效标识、修补路面、阴影情况下,车道线易被误检、漏检。弯曲的车道线、远端的车道线、环岛的车道线等情况的拟合难度较大,检测结果易模糊不清等。

4. 静态物体检测(SOD: Static Object Detection)

静态物体检测是对交通红绿灯、交通标志等静态物体的检测识别。这也是自动驾驶行驶中遇到最多的物体之一。其中红绿灯、交通标识属于小物体检测,在图像中所占的像素比极少,尤其远距离的路口,识别难度更大。

而视觉检测,在强光照的情况下,有时人眼都难以辨别,而停在路口的斑马线前的汽车,需要对红绿灯进行正确地识别才能做下一步的判断。交通标识种类众多,采集到的数据易出现数量不均匀的情况,导致检测模型训练不完善。

4

总结

从上述对于目前感知模块的总结来看,现环境的感知技术较于之前已经有了巨大的提升,从目前辅助驾驶的落地程度就可见一斑。但与此同时,要想实现真正的无人驾驶,需要达到人肉眼的检测精度及稳定性,对于感知模块来说是一个巨大的挑战。并且由于深度学习算法的天然缺陷,如何应对数据集里从未见过的物体,如何处理极端场景下的Corner case,将会是阻碍在感知发展前的一道难题。而只有充分解决了这些问题,真正的无人驾驶才有可能落地。

- End -

此文内容来自智车科技,如涉及作品内容、版权和其它问题,请于联系工作人员,我们将在第一时间和您对接删除处理!

扫码关注

扫码关注