人工智能政策是指政府、国际组织、企业和其他利益相关方为管理、规范和引导人工智能(AI)技术的开发、应用及其社会影响所制定的法律法规、标准、道德指南和战略框架。人工智能政策涵盖广泛的议题,如技术标准、数据隐私、伦理道德、监管框架、行业规范、就业影响、国家安全和国际合作等。

人工智能政策的主要内容

伦理与道德准则:确保AI系统在开发和应用过程中遵守伦理标准,避免对社会产生负面影响。例如,AI的公平性、透明性、可解释性以及防止偏见和歧视。

数据隐私与安全:规范AI技术在数据处理和使用中的隐私保护,确保用户数据不被滥用,同时保障网络安全和信息安全。

法律与监管框架:为AI技术的应用制定法律约束,如自动驾驶、医疗AI系统、智能金融系统等领域的安全、责任和合规性要求。

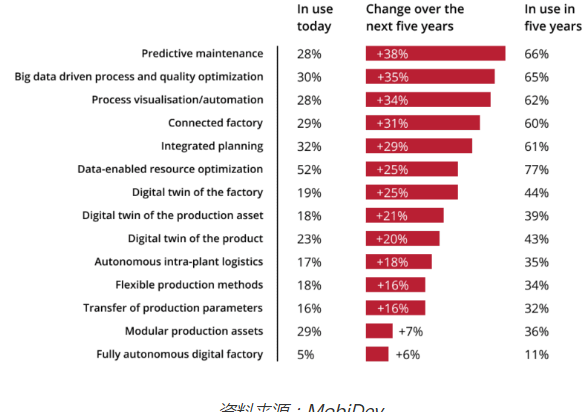

就业与经济影响:评估AI对劳动力市场的冲击,制定政策缓解自动化对就业的影响,如推动职业转型培训和社会保障。

国家安全与国际合作:应对AI在军事、网络安全和经济领域的潜在威胁,推动国际间的合作与治理,避免AI技术引发的国际竞争失衡或冲突。

创新与竞争力:支持AI研究与创新,促进技术突破,确保在全球科技竞争中的领先地位。这包括政府资助AI研发、推动AI教育以及建立创新友好的环境。

为什么人工智能政策很重要?

确保技术的道德性与社会责任:AI的发展潜力巨大,但其滥用可能带来社会、道德和法律问题。AI政策确保技术的开发和应用符合道德标准,避免对弱势群体产生歧视、隐私侵害或其他不公正的影响。

保护个人隐私与数据安全:AI依赖于海量数据,尤其是个人数据。政策框架有助于规范数据收集、存储、处理和共享,确保用户数据的隐私和安全得到充分保障。

减少对就业市场的冲击:AI和自动化技术可能导致某些行业的工作岗位消失。合理的AI政策可以帮助缓解这种影响,通过推动再培训计划、社会保障政策等手段,支持劳动力的转型和适应。

推动技术创新与经济发展:通过制定清晰的规则和激励机制,AI政策可以促进技术创新,支持新兴行业的崛起,提升国家在全球科技竞争中的地位。

规范责任与安全:AI在自动驾驶、医疗等领域的应用可能带来法律和安全挑战,明确责任划分至关重要。AI政策能够制定相关的安全标准和法律框架,以确保当事故或技术失败发生时,责任分配清晰。

保障国家安全与国际竞争:AI在军事和网络安全领域的潜在应用使得国家安全成为焦点问题。政策不仅可以防范AI在军事领域的潜在风险,还可以规范技术出口和国际合作,确保技术平衡发展。

国际合作与标准化:人工智能是全球性技术,其应用与影响跨越国界。AI政策可以帮助各国就技术标准、道德准则和监管方式达成共识,避免技术壁垒和潜在的国际冲突。

当前的人工智能政策

当前,全球各国和国际组织正积极制定和实施关于人工智能政策的框架和指导方针,以应对人工智能(AI)技术的快速发展及其带来的广泛社会影响。以下是一些代表性和具有重要影响力的AI政策概述:

1、欧盟的《人工智能法案》

欧盟是全球人工智能政策领域的领导者之一,其《人工智能法案》是世界上首部专门针对AI系统的综合立法草案,具有重大影响。

核心内容:

风险分类:将AI应用按风险级别分为四类:不可接受风险、高风险、有限风险和最小风险。不可接受风险的AI将被禁止, 如社会信用评分;高风险的AI将面临严格的合规要求 ,如医疗设备和交通系统 。

透明性要求:要求透明度,特别是对于人机互动、深度伪造等场景,用户应当知情。

合规性评估:对高风险的AI系统实施强制的合规性评估,包括数据治理、风险管理和安全性测试。

重要性:这一法案将为企业设定法律框架,确保AI系统的安全性和透明性,并为其他国家提供立法参考。

2、美国的《人工智能国家战略》

美国政府于2019年发布了《人工智能国家战略》,旨在推动美国在AI领域的全球竞争力。

核心内容:

推动AI研究与开发:加大对基础研究和应用研究的投入,尤其在AI技术的创新和突破方面。

数据和计算资源的开放:鼓励政府数据的开放,促进AI开发者的使用,并加大对超级计算资源的投资。

劳动力发展与培训:支持AI相关的人才培养和教育,提升劳动力在AI时代的适应能力。

道德与安全:确保AI技术的开发与应用符合道德标准,保护公民隐私和安全。

重要性:美国的AI政策重点在于技术领先和国家安全,同时关注技术应用的道德与社会影响。

3、中国的《新一代人工智能发展规划》

中国在2017年发布了《新一代人工智能发展规划》,明确了中国在2030年前成为全球AI领域领军者的目标。

核心内容:

三步走战略:到2020年,AI产业与技术初步布局;到2025年,AI成为经济发展的主要驱动力;到2030年,成为全球领先的AI创新中心。

推动产业融合:大力推动AI与制造业、农业、金融、医疗等行业的融合,提升产业智能化水平。

国际合作与竞争:积极参与国际AI合作,提升中国的国际话语权,同时防范AI技术对国家安全的潜在威胁。

道德和法律框架:支持AI道德的研究,确保技术应用符合社会道德标准。

重要性:中国的AI政策具有强烈的产业导向,强调技术创新的商业应用和国际竞争力。

4、英国的《人工智能国家战略》

英国在2021年发布了《人工智能国家战略》,旨在推动AI创新,并确保英国在全球AI发展中的领导地位。

核心内容:

促进AI研究与开发:加强基础AI研究,提升英国的AI技术创新能力。

AI技能与教育:投资培养AI相关人才,增加计算机科学和数据科学教育。

监管与标准:推动AI的道德和法规框架,确保技术在发展中遵循道德规范,同时推动国际标准化。

促进AI在公共服务中的应用:特别是在医疗、司法和公共管理等领域推广AI技术。

重要性:英国的战略侧重于AI的广泛应用和国际标准的制定,并致力于将AI技术引入公共服务领域。

5、日本的《人工智能技术战略》

日本的《人工智能技术战略》于2017年由日本内阁办公室发布,主要聚焦于推动AI技术在经济和社会中的应用。

核心内容:

产业创新:通过AI推动制造、医疗、农业等关键领域的技术转型,提升产业效率。

AI人才培养:支持从基础教育到高等教育的AI相关课程,促进技能转型。

道德与安全:注重AI技术应用中的道德和安全,尤其是确保AI的公平性和透明性。

重要性:日本的AI政策强调产业应用和社会福利,尤其在制造业和医疗等领域发挥重大作用。

6、联合国教科文组织的《人工智能道德建议》

2021年,联合国教科文组织(UNESCO)发布了《人工智能道德建议》,这是首个全球性的AI道德准则,旨在促进AI的负责任使用。

核心内容:

保护人权:确保AI的开发和使用尊重人权,包括隐私权、非歧视权和公正性。

公平性与包容性:防止AI技术加剧社会不平等,确保AI为所有人服务,尤其是弱势群体。

环境可持续性:在开发和使用AI技术时,考虑其对环境的影响,倡导绿色技术。

国际合作:推动各国在AI道德和治理上的全球合作与对话。

重要性:联合国教科文组织的建议为全球AI道德标准奠定了基础,确保技术应用符合国际人权和道德标准。

总结

当前全球关于人工智能的政策框架日益多样化,各国和国际组织根据各自的技术水平、社会需求和经济目标制定了不同的AI政策。无论是推动技术创新、保护数据隐私、保障道德安全,还是促进国际合作,这些政策都旨在确保人工智能能够为社会带来最大化的积极影响,同时减少潜在的负面后果。

此文内容来自千家网,如涉及作品内容、版权和其它问题,请于联系工作人员,我们将在第一时间和您对接删除处理!

扫码关注

扫码关注

![电子设计:Z变换解差分方程 [学以致用系列课程之数字信号处理]](https://api.fanyedu.com/uploads/image/ab/f8c7c60262b4726f47e780f7e75a9e.png)

![电子设计:频域采样定理及FFT算法[学以致用系列课程之数字信号处理]](https://api.fanyedu.com/uploads/image/5e/e20549b95077812a27c92ed71009cb.png)